Fundaron Anthropic convencidos de que la IA es peligrosa. Cuatro años después recaudaron 67.000 millones de dólares para seguir construyéndola

Corría enero de 2021 cuando Dario Amodei, vicepresidente de Investigación de OpenAI, y su hermana Daniela, que lideraba operaciones, tomaron una decisión que sacudiría a la industria tecnológica: renunciaron. No se fueron solos. Los acompañaron siete investigadores de primera línea, todos con la misma inquietud: OpenAI estaba priorizando la velocidad sobre la seguridad. Querían construir otra cosa.

Lo que fundaron en San Francisco se llamó, en su versión más simple, una promesa: inteligencia artificial que no dañe a la humanidad. La empresa se constituyó como Public Benefit Corporation —una corporación de beneficio público—, una figura legal que obliga a sus directivos a considerar el impacto social junto al retorno financiero. El nombre que eligieron fue Anthropic. Y el modelo que desarrollarían llevaría el nombre de un matemático: Claude Shannon.

El origen de una ruptura

Dario Amodei no era un recién llegado. Físico con doctorado en biofísica de Princeton, había sido investigador en Google Brain antes de unirse a OpenAI, donde fue una pieza clave en el desarrollo de las redes GPT-2 y GPT-3. Pero cuanto más poderosos se volvían los modelos, más le preocupaba lo que podían hacer si salían al mundo sin los controles adecuados.

La hoja de ruta inicial de Anthropic era diferente a la de sus competidores: antes de lanzar un producto, querían entender cómo funcionaba por dentro. Desarrollaron lo que llamaron Constitutional AI (IA Constitucional), un método por el cual el modelo aprende a evaluarse a sí mismo siguiendo un conjunto explícito de principios éticos. No era marketing: era ingeniería aplicada a la alineación de valores.

En mayo de 2021, con la confianza de inversores como Jaan Tallinn —cofundador de Skype—, Dustin Moskovitz —cofundador de Facebook— y Eric Schmidt —ex CEO de Google—, Anthropic levantó 124 millones de dólares en su primera ronda. El dinero alcanzó para contratar talento y comenzar a entrenar modelos propios.

El dinero de FTX y la primera controversia

En abril de 2022 llegó el primer gran espaldarazo financiero: una Serie B de 580 millones de dólares liderada por Sam Bankman-Fried, a través de su firma de trading Alameda Research. En ese momento, el nombre de Bankman-Fried era sinónimo de éxito en el universo cripto. Meses después, su imperio colapsaría en uno de los mayores fraudes financieros de la historia reciente: la quiebra de FTX.

La asociación dejó una marca incómoda, aunque Anthropic no enfrentó consecuencias legales directas. Los fondos, mientras tanto, ya habían cumplido su función: financiar el entrenamiento de las primeras versiones de Claude, que ese mismo verano quedó listo para uso interno pero no fue publicado. La empresa decidió esperar. No quería desatar una carrera armamentista en inteligencia artificial.

2023: el año en que Claude llegó al mundo

El lanzamiento de ChatGPT en noviembre de 2022 cambió el mapa. OpenAI le había mostrado al mundo que la IA conversacional tenía demanda masiva. Anthropic ya no podía esperar.

En marzo de 2023 lanzó Claude en acceso limitado, y en julio presentó Claude 2, su versión pública. El modelo se distinguía de la competencia por su longitud de contexto —capaz de procesar documentos extensos—, su tono más cuidadoso y su resistencia a generar contenido dañino.

El mismo año, los grandes jugadores de la nube empezaron a moverse. Google invirtió 300 millones de dólares en febrero, convirtiéndose en socio estratégico con alrededor del 10% de la compañía. En mayo, una nueva ronda de 450 millones sumó a Spark Capital, Salesforce y Zoom. Pero el movimiento que definió el año fue el de Amazon.

En septiembre de 2023, la compañía de Jeff Bezos anunció una inversión de hasta 4.000 millones de dólares, con un primer tramo de 1.250 millones. El acuerdo incluía que Anthropic usara los chips Trainium e Inferentia de Amazon para entrenar sus modelos, y que Claude estuviera disponible en Amazon Bedrock, la plataforma de IA para empresas de AWS. Era una alianza estratégica disfrazada de inversión.

Para fin de año, los ingresos anualizados de Anthropic habían superado los 100 millones de dólares. Modesta cifra para una empresa que ya valía varios miles de millones, pero suficiente para demostrar que había mercado real.

Claude 3 y el salto al primer nivel

En marzo de 2024, Anthropic lanzó la familia Claude 3 en tres versiones: Opus, Sonnet y Haiku. Era la primera vez que el laboratorio presentaba modelos con niveles diferenciados de capacidad y costo, siguiendo la lógica de la industria pero con una salvedad: en varios benchmarks de referencia, Claude 3 Opus superó a GPT-4 de OpenAI y a Gemini Ultra de Google.

El mercado lo notó. Los ingresos anualizados pasaron de 100 millones a finales de 2023 a 1.000 millones a finales de 2024, un crecimiento de casi el 1.000% en doce meses. En junio llegó Claude 3.5 Sonnet, que volvió a redefinir el estándar. En febrero de 2025, Claude 3.7 Sonnet introdujo el concepto de razonamiento híbrido: el modelo podía “pensar” de forma extendida antes de responder, mejorando dramáticamente su desempeño en matemáticas, código y lógica.

El equipo también creció. En mayo de 2024 se incorporó Krishna Rao como primer CFO, Mike Krieger —cofundador de Instagram— como responsable de producto, y Jan Leike —ex OpenAI— para liderar el equipo de seguridad. Amazon, por su parte, comprometió 4.000 millones adicionales en noviembre de 2024, duplicando su inversión total.

La Serie E y la era de los 61.500 millones

En marzo de 2025, Anthropic cerró una Serie E de 3.500 millones de dólares liderada por Lightspeed Venture Partners, con la participación de Fidelity, Cisco, Salesforce y D1 Capital. La valuación post-money llegó a 61.500 millones de dólares. Era el segundo laboratorio de IA más valioso del mundo, detrás solo de OpenAI.

En mayo de ese año lanzó Claude 4, con Opus 4 y Sonnet 4, modelos que por primera vez recibieron una clasificación de seguridad de Nivel 3 en el propio sistema de evaluación interno de Anthropic —el Responsible Scaling Policy—, una señal de que las capacidades habían alcanzado un umbral que requería controles adicionales. También lanzó el Model Context Protocol (MCP), un estándar abierto para conectar modelos de IA con fuentes de datos externas que fue adoptado rápidamente por la industria, incluido OpenAI.

Los ingresos anualizados llegaron a 3.000 millones en el segundo trimestre. El gasto en publicidad también apareció por primera vez: en febrero de 2026, Anthropic emitió dos comerciales durante el Super Bowl LX, aunque aclaró que Claude no incorporaría publicidad, en contraste explícito con OpenAI.

La valuación de 380.000 millones y el presente

En febrero de 2026, Anthropic cerró una Serie G de 30.000 millones de dólares —la segunda mayor ronda de venture capital de la historia, detrás solo de la de OpenAI— liderada por GIC y Coatue, con participación de Founders Fund, Iconiq Capital, Dragoneer y MGX. La valuación post-money alcanzó los 380.000 millones de dólares.

Con ingresos anualizados de 14.000 millones y más de 67.000 millones recaudados desde su fundación, Anthropic ya no es una startup en el sentido tradicional. Es una de las empresas tecnológicas más capitalizadas del mundo, con alianzas con Amazon, Google, Microsoft y Nvidia.

Sus productos más recientes incluyen Claude Cowork —una herramienta de productividad para empleados no técnicos que conecta Claude con Gmail, Google Drive, DocuSign y plataformas financieras— y Claude Code, su asistente de programación que pasó de experimento a herramienta indispensable en miles de equipos de ingeniería.

El 78% del uso global de Claude proviene de fuera de los Estados Unidos. La compañía anunció planes de triplicar su fuerza laboral internacional, con foco en India, Japón, Corea, Australia y Europa.

El dilema que no desaparece

Cuatro años después de su fundación, Anthropic sigue siendo una empresa que se define por una tensión: construir la inteligencia artificial más poderosa del mundo mientras sostiene que esa misma tecnología podría ser peligrosa. Dario Amodei lo ha dicho en repetidas oportunidades: el riesgo existe, y precisamente por eso es necesario que quienes lo ven con claridad estén al frente del desarrollo.

El Long-Term Benefit Trust —el fideicomiso que tiene poder de nombrar directores y orientar las decisiones estratégicas hacia la seguridad y la ética— sigue siendo la pieza que diferencia a Anthropic de sus competidores. Ninguno de sus grandes inversores tiene un asiento en el directorio. La arquitectura de gobierno fue diseñada para resistir la presión del mercado.

Si eso alcanzará cuando los modelos sean aún más poderosos es la pregunta que Anthropic, más que ninguna otra empresa del sector, se hace en voz alta. Y por ahora, esa pregunta sigue abierta.

La operación más reciente —la Serie G de 30.000 millones— se cerró en febrero de 2026 y los fondos se destinarán a investigación de frontera, desarrollo de productos e infraestructura de cómputo. La empresa no tiene fecha prevista para una oferta pública inicial.

La entrada Fundaron Anthropic convencidos de que la IA es peligrosa. Cuatro años después recaudaron 67.000 millones de dólares para seguir construyéndola se publicó primero en Revista Mercado.

También te puede interesar

El dilema del precio del crudo

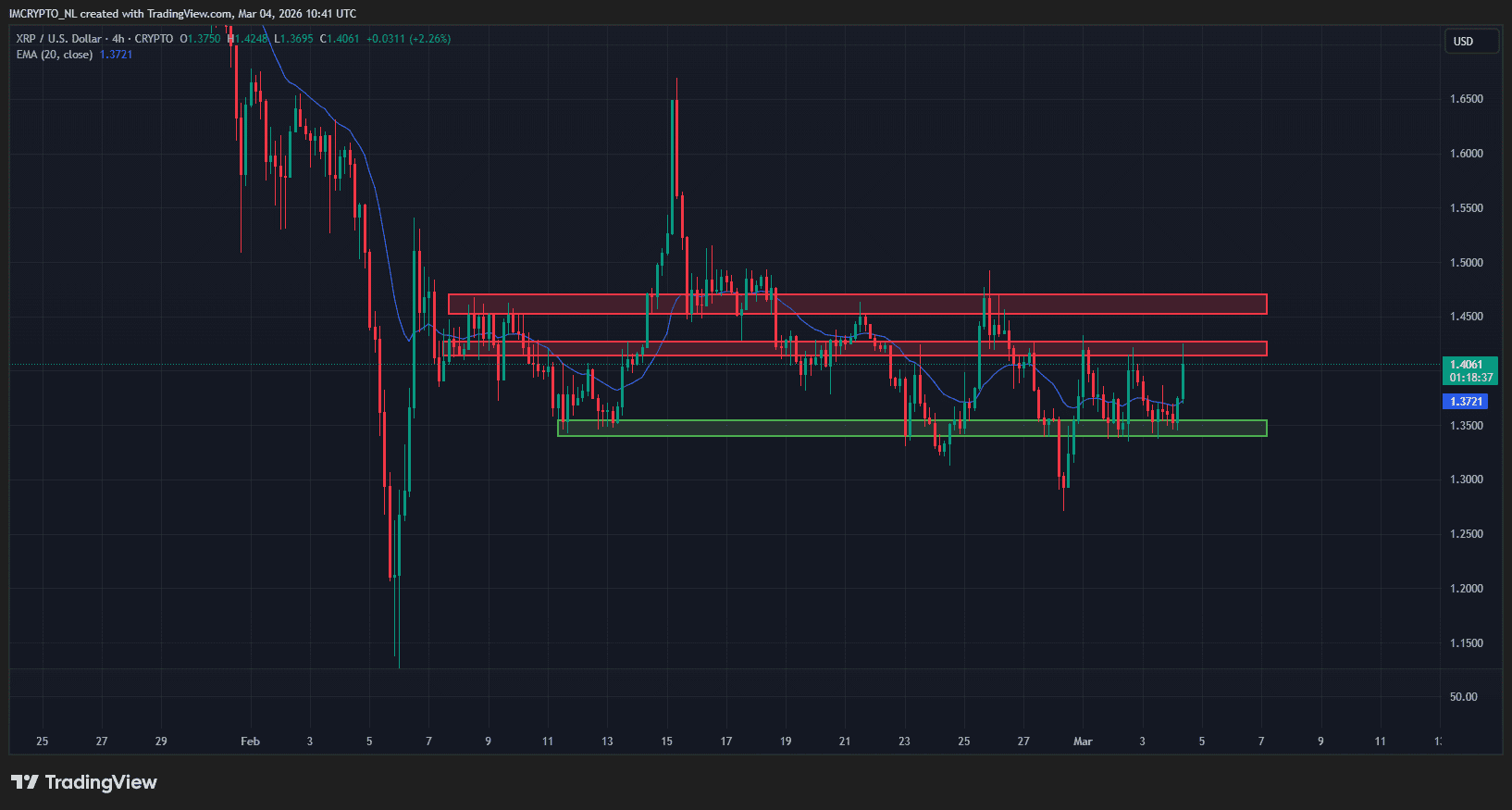

XRP sube un 5% y se topa con una barrera que puede cambiar su rumbo