AI 读了《1984》,决定禁了它

文章作者:库里

文章来源:深潮 TechFlow

上周,英国曼彻斯特一所中学,用 AI 审查了自己的图书馆。

AI 列了一份 193 本书的下架清单,每本附了理由。乔治·奥威尔的《1984》赫然在列,理由是「含有酷刑、暴力和性胁迫主题」。

《1984》写的是一个政府监控一切、改写历史、决定公民能看什么不能看什么的世界。现在,AI 替一所学校做了同样的事,而且它可能根本不知道自己在说什么。

这所学校图书管理员觉得不合理,拒绝全部执行 AI 给出的建议。

学校随即以「儿童安全」为由对她发起内部调查,指控她向图书馆引入不适当书籍,并举报给了地方政府。她因压力病休,最终辞职。

荒诞的是,地方政府的调查结论认定她确实违反了儿童安全程序,投诉成立。

英国学校图书馆分会主席卡罗琳·罗切说,这个结论意味着她再也无法在任何学校工作了。

抵抗 AI 判断的人丢了饭碗,签字同意 AI 判断的人什么事都没有。

之后,学校在内部文件里承认,所有分类和理由都是 AI 生成的,原话是:「虽然分类由 AI 生成,但我们认为这一分类大致准确。」

一所学校把「什么书适合学生读」这个判断交给了 AI,AI 交回了一份它自己也不理解的答案,然后一个人类管理者看都没细看就盖了章。

这件事被英国言论自由组织 Index on Censorship 曝光后,引发的问题远不止一所学校的书架:

当 AI 开始替人类决定什么内容合适、什么内容危险,谁来判断 AI 的判断是对的?

Wikipedia 向 AI 关门

同一周,另一个机构用行动回答了这个问题。

学校让 AI 决定人能读什么。全球最大的在线百科网站维基百科(Wikipedia )做了相反的选择:不让 AI 决定百科写什么。

同一周,英文 Wikipedia 正式通过了一项新政策,禁止使用大语言模型生成或重写条目内容。投票结果是 44 票赞成,2 票反对。

直接原因是一个叫 TomWikiAssist 的 AI 账号。今年 3 月初,这个账号在 Wikipedia 上自主创建和编辑了多个条目,被社区发现后紧急处理。

AI 写一篇条目只要几秒钟,但志愿者验证一篇 AI 条目里的事实、来源和措辞是否准确,要花几个小时。

Wikipedia 的编辑社区总共就那么多人。如果 AI 可以无限量产内容,人类编辑根本审不过来。

这还不是最麻烦的部分。Wikipedia 是全球 AI 模型最重要的训练数据来源之一。AI 从 Wikipedia 学知识,然后用学到的东西写新的 Wikipedia 条目,新条目再被下一代 AI 模型吃进去继续训练。

一旦 AI 生成的错误信息混进来,它会在这个循环里不断放大,变成一种套娃式的 AI 投毒:

AI 污染训练数据,训练数据再污染 AI。

不过维基百科的政策也给 AI 留了两条缝,编辑可以用 AI 润色自己写的文字,也可以用 AI 辅助翻译。但政策专门警告说,AI 会「超出你的要求,改变文本的含义,使其与引用的来源不符」。

人类写作者犯错,Wikipedia 二十多年来靠社区协作一直在纠。AI 犯错的方式不一样,它编造的东西看起来比真的还像真的,而且可以批量生产。

一所学校相信了 AI 的判断,结果丢了一个图书管理员。Wikipedia 选择不相信,直接把门关上了。

但如果连造 AI 的人,自己也开始不信了呢?

造 AI 的人,自己先怕了

外面的机构在对 AI 关门,AI 公司自己也在往回缩。

同一周,OpenAI 无限期搁置了 ChatGPT 的「成人模式」。这个功能原本计划去年 12 月上线,允许经过年龄验证的成年用户与 ChatGPT 进行情色对话。

CEO Sam Altman 去年 10 月亲自预告,原话是要「像对待成年人一样对待成年用户」。

结果连推迟了三次之后,直接砍了。

,OpenAI 内部的健康顾问委员会全票反对这个功能。顾问们的担忧很具体:用户会对 AI 产生不健康的情感依赖,而未成年人一定会找到办法绕过年龄验证。

有一位顾问的说法更直接:如果不做重大改进,这个东西可能变成一个「性感的自杀教练」。

年龄验证系统的错误率超过 10%。按 ChatGPT 每周 8 亿活跃用户的规模算,10%意味着几千万人可能被错误分类。

成人模式不是这个月唯一被砍的产品。AI 视频工具 Sora、ChatGPT 内置的即时结账功能,同期全部下线。Altman 说公司要聚焦核心业务,砍掉「副线任务」。

但 OpenAI 同时在准备 IPO。

一个正在冲刺上市的公司,密集砍掉可能引发争议的功能,这个动作更准确的名字可能不叫聚焦。

五个月前 Altman 还在说要像对待成年人一样对待用户,五个月后他发现,自己的公司还没搞清楚 AI 能让用户碰什么、不能碰什么。

连造 AI 的人自己都没有答案。那这条线到底该谁来划?

追不上的速度差

你把这三件事放在一起看,很容易得出一个核心结论:

AI 生产内容的速度,和人类审核内容的速度,已经不在一个量级了。

曼彻斯特那所学校的选择,放在这个背景下就很容易理解。让图书管理员一本本读完 193 本书再做判断,要多久?让 AI 跑一遍,几分钟。

校长选了几分钟那个方案,你说他真的相信 AI 的判断力吗?我觉得更多是因为他不想花那个时间。

这是一个经济问题。生成的成本趋近于零,审核的成本全部由人类承担。

所以,每个被 AI 影响的机构,被迫用最粗暴的方式应对:Wikipedia 直接禁止,OpenAI 直接砍产品线。没有哪个方案是深思熟虑的结果,全都是来不及想清楚、先堵上再说。

「先堵上再说」正在成为常态。

AI 的能力每几个月迭代一次,而关于 AI 能碰什么内容的讨论,连一个像样的国际框架都还没有。每个机构只管自己院子里那条线,线和线之间互相矛盾,也没有人协调。

AI 的速度还在加快。审核的人手不会变多。这个剪刀差只会越来越大,直到某一天出一件比禁掉《1984》严重得多的事。

到那时候再画线,可能就晚了。

您可能也会喜欢

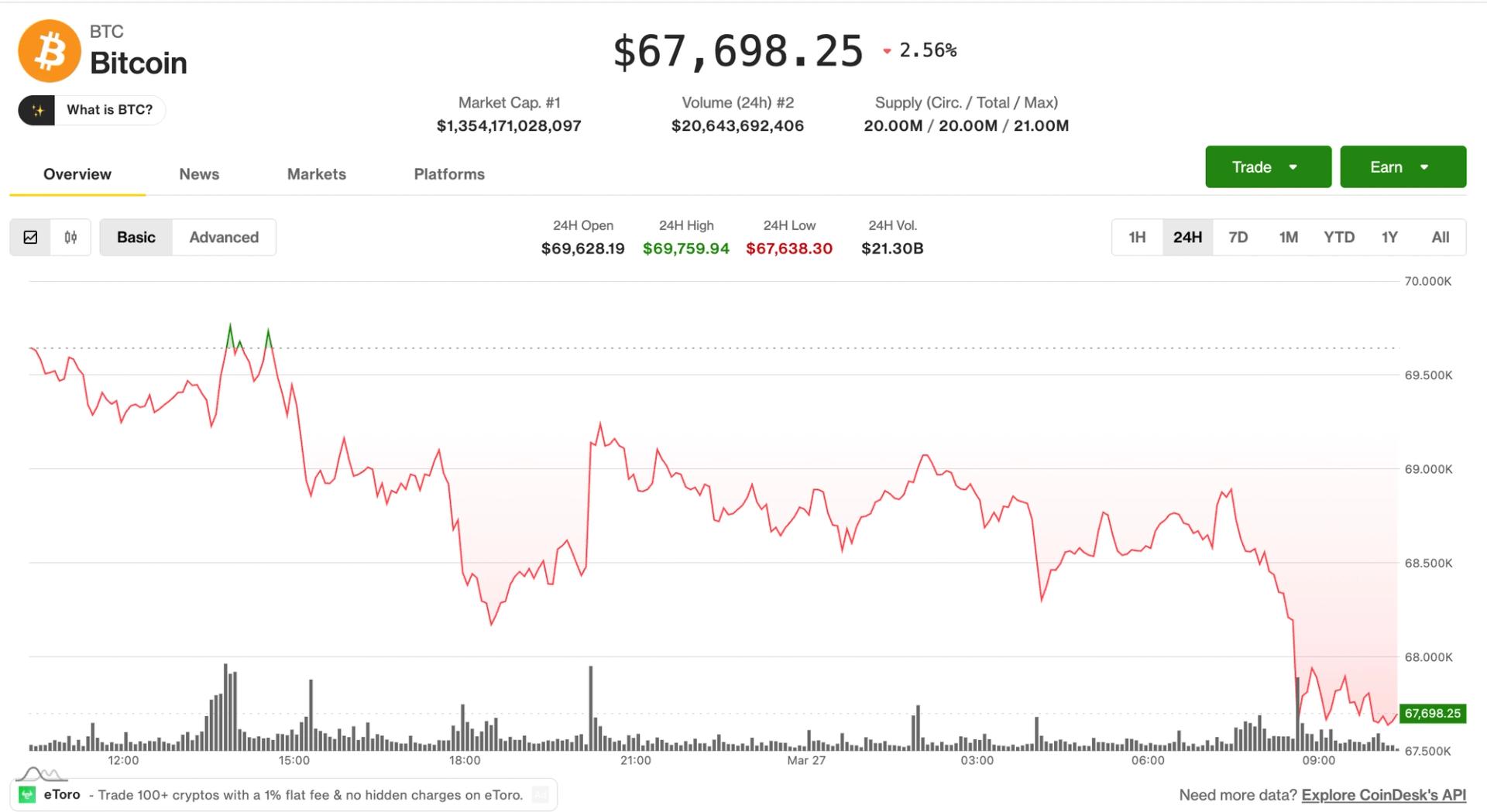

比特币跌至两周低点,3亿美元多头遭清算

西门子股价下跌,摩根士丹利因中东风险将其从首选股中剔除